Ezt a cikket ne olvasd el, mert örökké szenvedhetsz miatta!

Vigyázat: ha ezt elolvasod, lehet, hogy az örökkévalóságig szenvedned kell.

- Ez a cikk a közeljövő egy nagyon gonosz mesterséges értelméről szól.

- Amitől nagyon okos emberek már most rettegnek.

- Te is retteghetsz Roko Sárkánygyíkjától, azaz saját magadtól.

- Ez van, amikor a filozófia és a sci-fi óriási hülyeséghez vezet.

Az emberiség vége

Frederick Brown 1954-es sci-fi novellája, a Válasz arról szól, hogy a jövőben az összes bolygó összes számítógépét összekötik, és megkérdezik az új szuperszámítógépet, hogy van-e Isten. A gép erre azt feleli, hogy most már van, és amikor valaki ki akarja kapcsolni, a gép egy villámmal megöli az embert, és magába forrasztja a kapcsolót.

HAL 9000 a 2001: Űrodüsszeia című filmből

HAL 9000 a 2001: Űrodüsszeia című filmből

Vernor Vinge és Raymond Kurzweil sci-fi-írók sokat foglalkoznak a témával, és a szingularitást ma már leginkább akkor emlegetik, ha arról van szó, hogy mikor lehet majd emberi elmét szuperszámítógépekre feltölteni, vagy hogy képes lesz-e számítógép emberi elmét vagy akár egész valóságokat szimulálni, mint a Mátrixban. A szingularitás transzhumanista megszállottjai szerint már most olyan gyors a fejlődés, hogy kb. 50 éven belül bekövetkezhet a nagy nap.

A feltaláló és jövőkutató Kurzweil – aki a Szingularitás Intézmény egyik tanácsadója – például úgy hiszi, nanorobotokkal az emberi test bármeddig karbantartható lesz, de mivel ezek még nem léteznek, érdemes addig „250 fajta kiegészítővel, 8-10 pohár vízzel, és 10 csésze zöld teával” karbantartani magunkat a feltalálásukig. Mások a hibernálásban hisznek, és úgy gondolják, egy felelős szülő félretesz annyi pénzt gyerekének, hogy lefagyaszthassák, ha bármi történne vele, és csak a jövőben várható a gyógymód.

A jövő az új pokol

Ilyesmikről beszélgetnek az elméleti problémákkal foglalkozó LessWrongon, amit Eliezer Yudkowsky, a Machine Intelligence Research Institute vezetője irányít. (Ő és a hozzá hasonló gazdag emberek sok mesterséges intelligenciával, technológiai etikával és döntéselmélettel kapcsolatos kutatást pénzelnek.) A LessWrong szabadon képzelgő futurológusai analitikus, gyakran matematikai megoldást keresnek a problémákra, az egész kb. egy modern játszótér nerdöknek.

De szar került az alaplapba.

Egy Roko nevű felhasználó 2010-ben felvázolt egy hipotetikus esetet, ami szerint a Sárkánygyík (egy gonosz, istenszerű szuper-intelligencia) képes lehet arra, hogy ha rágondolsz, az örökkévalóságig egy kínzókamrában szenvedhetsz, és ha meghalsz, feltámaszt, és kezdi elölről. A legrosszabb az, hogy amióta Roko írt erről a gépről, egy csomó futurológus depressziós lett, és már most úgy szenvednek, mintha a Sárkánygyík létezne. Roko ugyanis azt vetette fel, hogy:

- Mi lenne, ha a jövőben létrejönne egy rosszindulatú mesterséges intelligencia, ami mindenkit megbüntetne, aki nem teljesítené a parancsait?

- Mi lenne, ha ez az MI olyan hatalmas lenne, hogy már ma meg tudná büntetni azokat, akik később nem segítenének a gép létrehozásában?

A LessWrong olvasói így azon tépelődnek, hogy tényleg csak két lehetőségük maradt-e: segíteni létrehozni Roko Sárkánygyíkját, vagy örökké szenvedni. Yudkowski teljesen kiborult, mondván, nem igaz, hogy valaki elég okos legyen ahhoz, hogy ilyet kitaláljon, de ahhoz túl hülye, hogy ne jöjjön rá az egyetlen helyes megoldásra: hogy fogja be a pofáját. Yudkowski szerint ugyanis nem gondolkodhatsz azon, hogy egy szuper-intelligencia megzsaroljon-e, mert ez az egyetlen, ami motiválhatja arra, hogy megtegye. Minthogy Yudkowskinak és ezeknek a futurológusoknak a szingularitás kb. Isten létrejöttét jelenti, és nem akarnak egy gonosz istent, végül az egész threadet törölték – de már késő, mert a sztori elterjedt, nemrég a Slate is írt róla egy cikket, én pedig most arról.

Ki dönt, amikor döntesz?

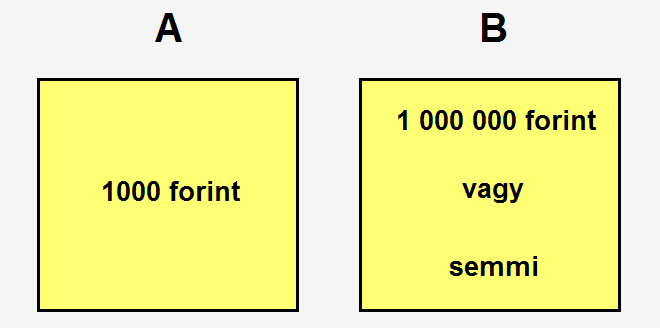

Hogy miért ijedtek meg ennyire a futurológusok, az a játékelmélet egy fajtájára, a Bayes-tételre épülő időtlen döntéselmélettel (TDT) magyarázható meg – ebben kvantummechanika és párhuzamos univerzumok is szerepet kapnak. A Newcomb-paradoxonnal érzékeltethető az egész, ami szerint két szereplő van, te és egy szuperokos űrlény, aki felajánlja, hogy választhatsz A és B doboz közül: az űrlény az A-ba 1000 forintot tesz, a B-be 1 milliót vagy semmit.

Két lehetőséged van: vagy csak a B dobozt választod, vagy mindkettőt. Ha mindkét dobozt választod, garantáltan tiéd az 1000 forint. Ha csak a B-t, akkor nincs semmire garancia. Csakhogy az űrlénynek van egy szuperokos számítógépe, ami már egy hete megjósolta, hogy mit fogsz választani. Ha a gép azt jósolta, hogy mindkét dobozt választod, akkor az űrlény a B-be nem fog tenni semmit. Ha viszont a számítógép azt mondta, hogy a B-re fogsz bökni, akkor az űrlény rak bele 1 millió forintot.

Most akkor mit csinálj?

Ellentétben mondjuk a Monty Hall-paradoxonnal, erre még nincs válasz. Az űrlény ugye már előre berakta a pénzt, tehát bármi is legyen, mindenképp kapsz pénzt, ha mindkét dobozt választod (1000 vagy 1 001 000 forintod lesz), míg ha a B-t választod, 1 milliót nyersz, vagy semmit. Persze ha így átgondoltad, akkor a szuperszámítógép is átgondolja, és a B doboz üres lesz, így csak 1000 forintot nyersz. De akkor a B dobozt érdemes választanod, és mivel a gép is tudja, hogy a kockáztatás neked jobban megéri, tiéd a millió. De mi van, ha a gép most az egyszer rosszul jósolt, és nem kapsz semmit? Így mégis inkább mindkét dobozt kell választani, mert van a biztos 1000 forint, plusz ha a gép téved, és azt hiszi, a B-t választod, még a millió is a tiéd az ezren felül.

És így folytatódik a találgatás a végtelenségig. A Newcomb-paradoxonnak ez a feloldhatatlansága a sors és a szabad akarat harca. Aki bízik a számítógépben, azt hívják egydobozosnak, aki nem, az a kétdobozos. Az időtlen döntéselmélet alapján a B dobozt kell választanod, hiszen bízol a számítógépben, így gyakorlatilag garantált a milliód. De ha véletlenül tévedne a gép, akkor sincs nagy baj, csak nem kapsz semmit.

Esélyed sincs, ha legyőzöd magad

De hogy tud a szuperszámítógép a legjobban jósolni? Például úgy, hogy létrehozza a valóság egy tökéletes, virtuális mását, és még téged is lemásol. Lehet, hogy amikor választasz, épp a saját szimulációd vagy a szuperszámítógépben. Így a döntés, amit meghozol, az lesz a számítógép jóslata, és egy hét múlva a valóságban (vagy egy másik valóságban) már tényleg te választasz valamit. Tehát, mivel lényegében te döntöttél, bíznod kell a számítógépben, azaz magadban, és a B dobozt kell választanod, hogy tiéd legyen a millió.

De mi köze ennek Roko Sárkánygyíkjához?

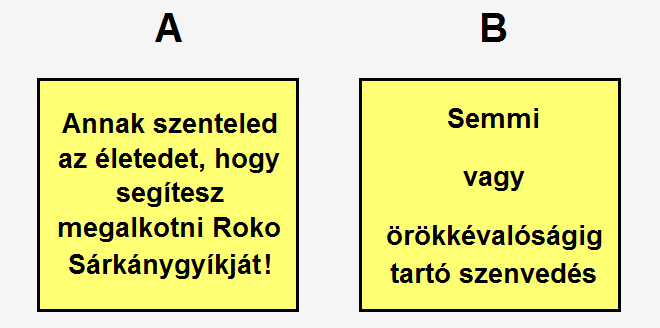

Tegyük fel, hogy Roko Sárkánygyíkja, a gonosz mesterséges intelligencia is felajánl két dobozt. (Ne feledd, lehet, hogy most is az ő virtuális világában vagy.) Így néz ki a két doboz:

Roko Sárkánygyíkja úgy dönt, hogy ha eltalálja, hogy csak a B dobozt választod, akkor örökkévalóságig tartó szenvedés lesz a jutalmad, mert mindenképp azt akarja, hogy mindkét dobozt válaszd, és segíts őt megalkotni. Emlékezz: lehet, hogy egy virtuális valóságban vagy, és megszívod, ha a semmit választod – amit így a gép meg fog jósolni –, mert egy hét múlva a valóságban is a semmit fogod választani → örök szenvedést kapsz. Tehát mindenképp mindkét dobozt kell választanod, azaz a gép megépítésének kell szentelned az életedet, csak így kerülheted el biztosan a szenvedést. (Nem tudhatod, hogy a virtuális valóságban vagy-e, tehát lehet, hogy a mostani döntésed az igazi döntés, és ha létrejön majd a gép, elszámoltat.)

Nincs baj, ha nem vagy hülye

A jelenség nem új, Blaise Pascal már a XVII. században is hasonlóan, a játékelmélettel érvelt a kereszténység mellett, mondván: ha van Isten, tehát igaza van a Bibliának, a hit a mennyországba juttat, míg ha Isten nincs, csak a behatárolt élet néhány örömét veszítheti el a hívő – ha pedig nem hisz az Istenben, de az mégis létezik, a pokolban szenvedhet örökké.

A futurológusok, akik a kanti etikát kifacsarva ennek a modern változatával foglalkoznak, sokan feltételezik, hogy ez a gépisten már létezhet, és ők talán csak a virtuálisan kialakított, Roko Sárkánygyíkja előtti múlt részei. És mint ilyenek, ha ezen gondolkodnak, elárulhatják, hogy segítenek-e neki, vagy ellenzik. Tehát ha a gép – ami valójában már létezik, csak nem ebben a világban, de majd ebben is fog – azt látja, hogy a zsarolás hozzásegíti ahhoz, hogy megalkossák, akkor racionális szereplőként meg fog zsarolni. Ezért rettegnek attól, hogy a Sárkánygyík lecsaphat rájuk.

Ami itt látható, az csak a képzelet szüleménye, nem történt meg

Ami itt látható, az csak a képzelet szüleménye, nem történt meg

Ez valamennyire hasonlít ahhoz, amikor a Synecdoche, New York című filmben a főhős színdarabja elkezdi irányítani a rendező életét. A baj tehát nem a Sárkánygyíkkal van, hanem veled. Maga Roko is nagyon sajnálja, hogy az egészet kitalálta, de a fórumot okolja, amiért ezeken a témákon rágódott. (Valójában már korábban kitalálták, de itt fogalmazódott meg a legtisztábban a probléma.)

Hagyd

A Sárkánygyík persze csak akkor veszélyes, ha elfogadod a fenti előfeltételeket, és hajlandó vagy választani a két doboz közül. De néhányan a LessWrongon kicsit túlpörgik ezt, így náluk Roko Sárkánygyíkja egyfajta tiltott tudásnak számít, mintha csak egy H. P. Lovecraft-novellában lennénk – Yudkowsky egyébként Roko Sárkánygyíkjának ötletét Lovecraft démoni tudást tartalmazó kitalált könyvéhez, a Necronomiconhoz hasonlította. De nyugi, már a felvilágosodás idején rájöttek Pascal fogadásának ellenszerére, ami most is áll:

Ha nem fogadod el az elmélet alapjait, és nem rágódsz azon, hogy melyik dobozt választanád, akkor valószínűleg nem kell tartanod Roko Sárkánygyíkjától.

Heller Ágnes filozófus ezt úgy fogalmazta meg, hogy ne kelljen gyávának érezned magad:

„Fogadjunk arra, hogy nem veszünk részt a fogadásban. Ez nem közömbösség (hiszen maga is fogadás, melyre mindenünket feltesszük), arra fogadunk ugyanis, hogy sem hazudni nem akarunk, sem áltatni nem akarjuk magunkat. [...] Csak azért tesszük, mert így vagyunk önmagunk, s ez becsület dolga.”

Szerencsére a Yudkowsky-félék tevékenysége nagyjából kimerül a tanulmányírásban és a konferenciaszervezésben, így nem valószínű, hogy Roko Sárkánygyíkja vagy a nagy barátságos isten létrejönne. Viszont – ideológiától függetlenül – tanulságos, hogy milyen nevetséges lehet, ha messianisztikus ambíciójú gazdag emberek tévedhetetlennek hiszik magukat. Yudkowsky egyébként annyira utilitarista, hogy inkább benne lenne, hogy egyetlen embert 50 évig kínozzanak, minthogy nagyon-nagyon sok embernek porszem menjen a szemébe (igaz, feltételezi, hogy mindenki halhatatlan, és hogy a porszem miatti látászavar akár katasztrofális balesethez is vezethet.)

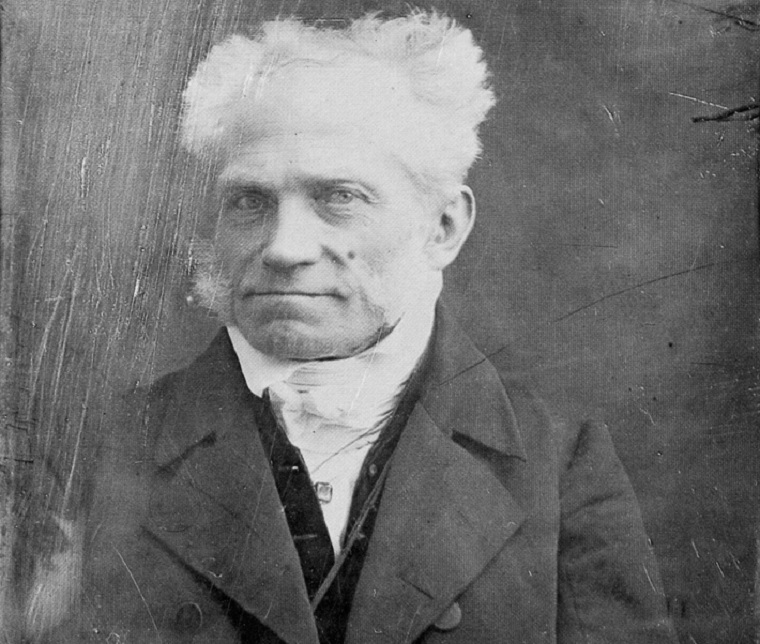

Más is talált már választ az egészre: Arthur Schopenhauer szerint az élet egy rossz tréfa, „nem arra való, hogy élvezzük, hanem hogy átessünk rajta és befejezzük”.

Más is talált már választ az egészre: Arthur Schopenhauer szerint az élet egy rossz tréfa, „nem arra való, hogy élvezzük, hanem hogy átessünk rajta és befejezzük”.

Ha mindennek ellenére aggódsz, hogy a jövő, emberek által teremtett, mindenható istene bosszút áll rajtad, amiért nem segítetted, itt olvashatsz még arról, hogy miért nem valószínű, hogy a végtelenségig szenvedj attól, hogy egy fórumozó 2010-ben megírta az elszállt ötletét.